网页抓取与网页爬虫:区别与应用场景

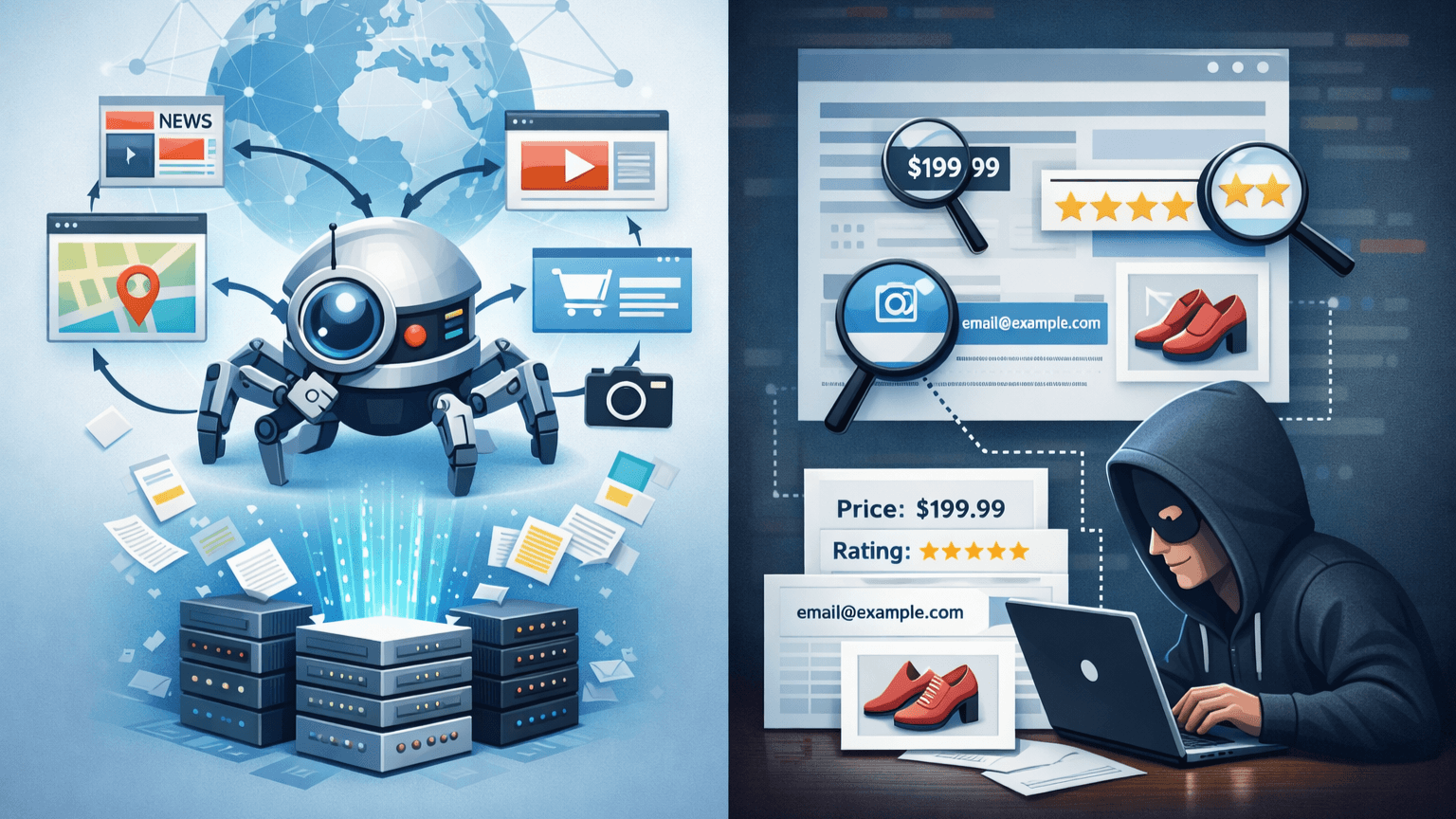

在现代互联网的发展中,数据的获取和利用变得越来越重要。无论是进行市场分析、获取新闻资讯,还是为科学研究提供数据支持,网页抓取(Web Scraping)与网页爬虫(Web Crawling)这两种技术常常被广泛使用。然而,很多人对这两者的概念存在一些混淆,认为它们是同一种技术。事实上,网页抓取与网页爬虫虽然有相似之处,但它们的工作原理、应用场景以及技术细节却有所不同。本文将深入探讨这两者的区别,并讨论它们各自的应用场景。

网页爬虫

1. 什么是网页爬虫?

网页爬虫,通常被称为“蜘蛛(Spider)”或“机器人(Bot)”,其核心任务是发现与索引。它像是一个在互联网迷宫中穿梭的探险家,从一个网页出发,通过点击页面上的链接跳转到另一个网页,循环往复。

2. 爬虫的工作原理

爬虫并不在意某个具体的表格或价格,它更关心的是结构与关系。

起始点(Seed URL):从给定的网址开始。

提取链接:识别页面上所有的超链接(Hyperlinks)。

更新索引:将新发现的页面记录在案。

遵守协议:专业的爬虫会优先读取网站的 robots.txt 文件,确认哪些区域是允许进入的。

3. 代表性案例

搜索引擎(Google, Bing, Baidu):这是爬虫最宏大的应用。它们持续不断地爬行,以确保搜索结果的实时性。

网站健康检查: 自动检查网站是否存在死链(404错误)。

网页抓取

1. 什么是网页抓取?

网页抓取是特定数据提取的过程。如果说爬虫是在森林里画地图,抓取就是直接走到某棵树下采摘那颗特定的果实。

2. 抓取的工作原理

抓取器通常针对特定的目标网页进行定制。

解析 HTML:通过解析网页的源代码(使用 XPath、CSS Selector 等技术),精确定位需要的数据。

数据清洗:将非结构化的网页内容转化为结构化的格式(如 JSON、CSV 或 Excel)。

存储:将提取出的电话号码、产品价格或评论存入数据库。

3. 代表性案例

价格监控:抓取亚马逊或其他电商平台的商品价格,用于竞价策略。

舆情分析:从社交媒体抓取特定关键词的帖子,分析公众情绪。

深度对比:抓取 vs 爬虫

为了更清晰地展示两者的区别,我们可以通过下表进行对比:

| 维度 | 网页爬虫 (Web Crawling) | 网页抓取 (Web Scraping) |

|---|---|---|

| 核心目的 | 发现、索引、搜索、画地图 | 提取、转化、存储、分析数据 |

| 广度与深度 | 广度优先,跨越数百万个域名 | 深度优先,聚焦于特定页面或字段 |

| 技术重心 | 链接提取、去重、遵守 robots.txt | HTML 解析、反爬策略应对、数据清洗 |

| 结果形式 | 建立索引数据库 (Search Index) | 结构化文件 (CSV, JSON, SQL) |

| 典型工具 | Apache Nutch, Scrapy (大批量模式) | Beautiful Soup, Selenium, Puppeteer |

它们是如何协同工作的?

在实际的大型项目中,抓取和爬虫往往是一对“黄金搭档”。

想象你要建立一个全国范围内的房地产分析平台:

爬虫阶段:你编写一个爬虫,在各大房产中介网站上跳转,搜集所有房源详情页的 URL,并把这些 URL 存入队列。

抓取阶段:你针对这些详情页设计一个抓取器,专门提取每一页中的“价格”、“平米数”、“地理位置”和“建造年份”。

提升抓取效率与绕过封禁

1. 在网页爬虫中使用代理

当爬虫在互联网上大量抓取页面时,目标网站可能会因为频繁的请求识别到异常流量并封禁IP,导致抓取过程无法继续进行。这时,使用代理可以有效解决这个问题。

IP轮换:通过代理池管理,爬虫可以不断更换IP地址,以避免被目标网站识别为异常流量。代理池是由大量代理IP组成的集合,爬虫可以从中随机选择IP进行请求。

突破IP封锁:一些网站会根据访问频率和IP地址的来源,设置IP封禁策略。通过使用代理,爬虫能够突破这些限制,实现无缝抓取。

地区和语言定制:代理服务器可以提供来自不同地区的IP地址,这对于需要抓取特定地区内容的抓取任务至关重要。例如,获取美国地区的产品价格信息时,可以使用美国代理IP,模拟本地用户的访问。

2. 在网页抓取中使用代理

网页抓取和网页爬虫类似,在面对一些网站的反爬虫措施时,也需要借助代理来进行绕过。尤其是抓取大型电商平台、社交媒体或新闻网站时,频繁的请求可能会导致账户封禁或IP封锁。因此,代理能够保障数据提取的连续性和稳定性。

防止IP封禁:当抓取平台的数据量非常庞大时,使用代理能够避免因为高频率请求而被目标网站封禁。

避免反爬虫策略:一些网站通过检测IP、User-Agent、Cookie等信息来识别是否为自动化抓取行为。使用代理可以通过动态更换IP、模拟真实用户访问,降低被识别为爬虫的风险。

应用场景

1. 电子商务的实时调价

电商巨头们通过抓取对手的库存和价格,利用算法实现自动调价。这需要极高的频率和抗封禁能力,通常涉及代理 IP的使用。

2. 机器学习与 AI 训练

当前的 LLM(大语言模型)如 GPT-4 的训练,离不开大规模的网页爬虫。它们抓取了维基百科、学术论文、新闻报道等海量文本,为模型提供了学习素材。

3. 金融投资与信用评估

对冲基金会抓取零售商的销量数据或物流信息,以预测财报表现。银行则可能抓取企业的公开涉诉信息进行风控评估。

法律与伦理:不可触碰的红线

无论是爬虫还是抓取,都必须在法律框架内运行。

版权与所有权:虽然数据是公开的,但大规模抓取并商业化可能侵犯数据库所有权。

隐私保护:严禁抓取涉及个人隐私(PII)的数据,如未经授权的个人身份证号、私密聊天记录等。

服务器负载:过高频率的抓取等同于 DDoS 攻击,会导致目标服务器宕机。

总结

现在你已经了解了网页爬虫和网页抓取的区别与应用。

IPDeep提供可用于网页爬虫和网页抓取的高质量代理IP,包括:

· 住宅代理

· 数据中心代理

· 移动代理

等多种代理类型,拥有超过1000万个高质量IP资源,覆盖全球200+国家和地区。立即创建账号,免费试用我们的代理服务吧!