网络数据新手指南:数据解析

在这个信息爆炸的时代,数据无处不在。无论是浏览网页、使用社交媒体,还是进行网购、查阅新闻,我们每天都在和海量数据打交道。但对于刚接触网络数据的新手来说,一个问题常常令人困惑:当数据摆在眼前时,我们该如何读懂它?这正是数据解析要解决的核心问题。

什么是数据解析?

简单来说,数据解析(Data Parsing)就是把原始数据转换成“有结构、可使用的数据”的过程。

网络上的数据通常以HTML、JSON、XML等格式存在。这些数据本质上是文本,但它们内部有一定的规则。数据解析的任务,就是按照这些规则,把我们真正需要的信息提取出来。

为什么需要数据解析?

如果没有数据解析,网络数据对计算机来说只是杂乱的文本。我们无法直接分析趋势、统计数量或做进一步处理。

比如:

你想统计某个网站上所有商品的价格;你想获取天气接口返回的温度数据;你想收集某类新闻的标题进行分析。

这些数据虽然都在网页或接口里,但必须经过解析,才能变成可操作的结构化内容,比如列表、字典或数据库记录。

数据解析的价值在于:

1. 提取有用信息

2. 实现自动化处理

3. 支持数据分析和决策

常见的数据类型

作为新手,首先要认识几种常见的数据格式。

1. HTML

HTML是网页的基础结构语言。当你打开一个网页,浏览器看到的其实是HTML代码。

例如:

如果你只想获取标题“今日新闻”,就需要通过解析HTML来提取 <h1> 标签中的内容。

常用工具:BeautifulSoup、lxml 等。

2. JSON

JSON是一种非常流行的数据交换格式,很多API接口都会返回JSON数据。

例如:

通过解析后,我们就可以单独访问:

·name

·age

·city

在Python中可以使用 json 模块进行解析。

3. XML

XML和HTML结构类似,也是一种标签结构的数据格式,常用于配置文件或某些接口。

数据解析的基本流程

无论数据来源是什么,解析的过程通常包括以下几个步骤:

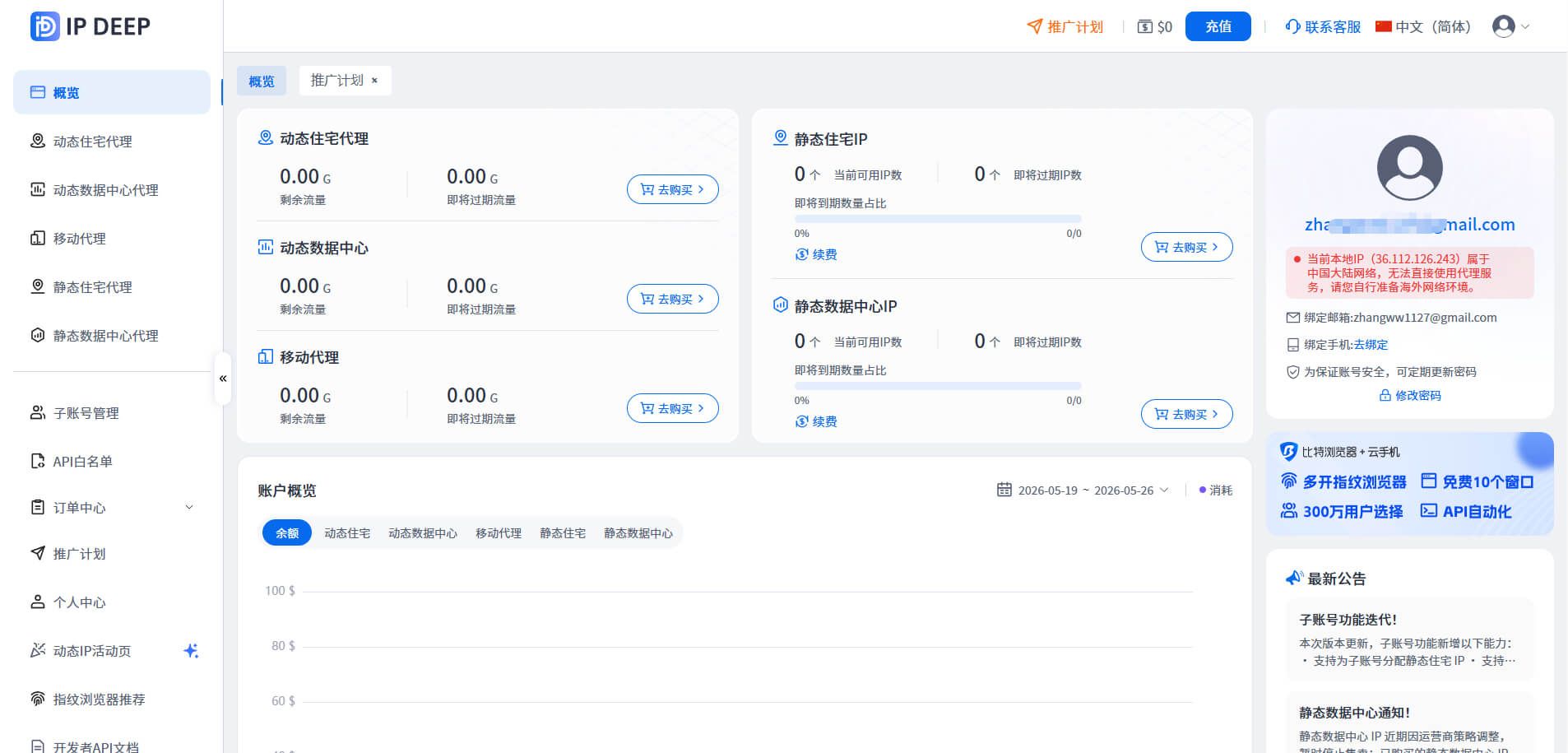

第一步:获取数据

数据可以来自网页请求(如 requests 获取的内容)、API接口、本地文件或数据库等不同来源。

第二步:确定数据格式

在进行数据解析之前,需要先判断数据属于 HTML、JSON、XML 还是纯文本等格式,因为不同的数据格式对应不同的解析方法。

第三步:提取目标信息

通过选择器、键名或标签路径等方式精准定位所需数据:

例如获取所有商品价格标签、提取 JSON 中的 “temperature” 字段,或抓取某个 class 下的文本内容。

第四步:结构化存储

解析后的数据可以存入列表、字典、CSV 文件、数据库或 Excel 文件中,以便后续进行统计分析或可视化处理。

常见解析工具

1. Python内置json库

适用于JSON解析。

优点:简单、直接。

2. BeautifulSoup

适用于HTML解析。

优点:语法简单、易上手、适合新手

3. lxml

性能更高,适合大规模数据解析。

4. 正则表达式(Regex)

适用于规则明确的文本匹配。

但不建议新手一开始过度依赖,因为复杂度较高。

数据解析中常见的问题

1. 页面结构变化

网站一旦改版,HTML结构改变,原有解析规则可能失效。

解决方法:重新查看页面结构,更新选择器。

2. 编码问题

有些数据包含中文或特殊字符,需要正确设置编码格式。

3. 动态加载内容

某些网站数据通过JavaScript加载,直接请求HTML可能看不到数据。

这时可能需要使用:

·接口抓取

·浏览器自动化工具

结语

数据解析是网络数据处理的第一步,也是数据分析、人工智能和自动化系统的重要基础,它能够帮助我们从大量无序的信息中提取有价值的内容,将原始数据转化为可分析和可利用的信息。对于初学者来说,理解常见的数据格式,掌握基本的解析工具,并持续进行实践,是进入数据领域的重要步骤。当你能够从一个网页中成功提取出第一条数据时,就说明你已经具备了进行数据获取和处理的基本能力。